Inteligência artificial

| Ciência |

|---|

| Portal • Categoria |

Inteligência artificial (por vezes mencionada pela sigla em português IA ou pela sigla em inglês AI - artificial intelligence) é a inteligência similar à humana exibida por mecanismos ou software. Também é um campo de estudo acadêmico. Os principais pesquisadores e livros didáticos definem o campo como "o estudo e projeto de agentes inteligentes", onde um agente inteligente é um sistema que percebe seu ambiente e toma atitudes que maximizam suas chances de sucesso.[1] John McCarthy, quem cunhou o termo em 1956 ("numa conferência de especialistas celebrada em Darmouth Colege" Gubern, Román: O Eros Eletrónico), a define como "a ciência e engenharia de produzir máquinas inteligentes". É uma área de pesquisa da computação dedicada a buscar métodos ou dispositivos computacionais que possuam ou multipliquem a capacidade racional do ser humano de resolver problemas, pensar ou, de forma ampla, ser inteligente. Também pode ser definida como o ramo da ciência da computação que se ocupa do comportamento inteligente[2] ou ainda, o estudo de como fazer os computadores realizarem coisas que, atualmente, os humanos fazem melhor.[3]

O principal objetivo dos sistemas de IA, é executar funções que, caso um ser humano fosse executar, seriam consideradas inteligentes. É um conceito amplo, e que recebe tantas definições quanto damos significados diferentes à palavra Inteligência.[4]Podemos pensar em algumas características básicas desses sistemas, como a capacidade de raciocínio (aplicar regras lógicas a um conjunto de dados disponíveis para chegar a uma conclusão), aprendizagem (aprender com os erros e acertos de forma a no futuro agir de maneira mais eficaz), reconhecer padrões (tanto padrões visuais e sensoriais, como também padrões de comportamento) e inferência (capacidade de conseguir aplicar o raciocínio nas situações do nosso cotidiano).[4]

O desenvolvimento da área começou logo após a Segunda Guerra Mundial, com o artigo "Computing Machinery and Intelligence" do matemático inglês Alan Turing[5], e o próprio nome foi cunhado em 1956.[6][7] Seus principais idealizadores foram os cientistas Herbert Simon, Allen Newell, John McCarthy, Warren McCulloch, Walter Pitts e Marvin Minsky, entre outros. A construção de máquinas inteligentes interessam à humanidade há muito tempo, havendo na história tanto um registro significante de autômatos mecânicos (reais) quanto de personagens místicos (fictícios) construídos pelo homem com inteligência própria, tais como o Golem e o Frankenstein. Tais relatos, lendas e ficções demonstram expectativas contrastantes do homem, de fascínio e de medo, em relação à Inteligência Artificial.[8][9]

Apenas recentemente, com o surgimento do computador moderno, é que a inteligência artificial ganhou meios e massa crítica para se estabelecer como ciência integral, com problemáticas e metodologias próprias. Desde então, seu desenvolvimento tem extrapolado os clássicos programas de xadrez ou de conversão e envolvido áreas como visão computacional, análise e síntese da voz, lógica difusa, redes neurais artificiais e muitas outras. Inicialmente a IA visava reproduzir o pensamento humano. A Inteligência Artificial abraçou a ideia de reproduzir faculdades humanas como criatividade, auto-aperfeiçoamento e uso da linguagem. Porém, o conceito de inteligência artificial é bastante difícil de se definir. Por essa razão, Inteligência Artificial foi (e continua sendo) uma noção que dispõe de múltiplas interpretações, não raro conflitantes ou circulares.[3]

Índice

- 1Visão geral

- 2Mitos sobre Inteligência Artificial

- 3Abordagens

- 4IA forte e IA fraca

- 5História

- 6Resoluções de problemas com IA

- 7Abordagens

- 8Aplicações Práticas de Técnicas de IA

- 9Vantagens e Desvantagens da utilização da inteligência artificial

- 10Pesquisadores de IA

- 11Ver também

- 12Referências

- 13Ligações externas

Visão geral[editar | editar código-fonte]

A questão sobre o que é "inteligência artificial", mesmo como definida anteriormente, pode ser separada em duas partes: "qual a natureza do artificial" e "o que é inteligência". A primeira questão é de resolução relativamente fácil, apontando no entanto para a questão de o que poderá o homem construir.

A segunda questão seria consideravelmente mais difícil, levantando a questão da consciência, identidade e mente (incluindo a mente inconsciente) juntamente com a questão de que componentes estão envolvidos no único tipo de inteligência que universalmente se aceita como estando ao alcance do nosso estudo: a inteligência do ser humano. O estudo de animais e de sistemas artificiais que não são modelos triviais, começa a ser considerados como matéria de estudo na área da inteligência.

Ao conceituar inteligência artificial, presume-se a interação com o ambiente, diante de necessidades reais como relações entre indivíduos semelhantes, a disputa entre indivíduos diferentes, perseguição e fuga; além da comunicação simbólica específica de causa e efeito em diversos níveis de compreensão intuitiva, consciente ou não.

Suponhamos uma competição de cara ou coroa, cujos resultados sejam observados ou não. Se na segunda tentativa der o mesmo resultado que a primeira, então não existiam as mesmas chances para ambas as 2 opções iniciais. Claro que a coleta de informação em apenas duas amostragens é confiável apenas porque a quantidade de tentativas é divisível pelo número de opções de resultados prováveis.

A verdade é que o conceito de cara ou coroa está associado a artigos de valor, como moedas e medalhas que podem evitar que as pessoas abandonem o jogo e induzir participantes a acompanhar os resultados até o final. Para manter a disposição do adversário em desafiar a máquina seria necessário aparentar fragilidade e garantir a continuidade da partida. Isso é muito utilizado em máquinas de cassino, sendo que vários apostadores podem ser induzidos a dispensar consideráveis quantias em apostas.

A utilização de uma máquina de resultados pode compensar a ausência de um adversário, mas numa partida de xadrez, por exemplo, para que a máquina não precise armazenar todas as informações que excedem a capacidade de próprio universo imaginável são necessárias fórmulas que possam ser armazenadas para que então sejam calculadas por princípios físicos, lógicos, geométricos, e estatísticos para refletir o sistema completo em cada uma das suas partes; como a integração do Google com Wikipedia, por exemplo.

Uma popular e inicial definição de inteligência artificial, introduzida por John McCarthy na famosa conferência de Dartmouth em 1956 é "fazer a máquina comportar-se de tal forma que seja chamada inteligente caso fosse este o comportamento de um ser humano." No entanto, esta definição parece ignorar a possibilidade de existir a IA forte (ver abaixo).

Outra definição de Inteligência Artificial é a inteligência que surge de um "dispositivo artificial". A maior parte das definições podem ser categorizadas em sistemas que: "pensam como um humano; agem como um humano; pensam racionalmente ou agem racionalmente".[10]

Mitos sobre Inteligência Artificial[editar | editar código-fonte]

Inteligência Artificial pode funcionar como nosso cérebro[editar | editar código-fonte]

A IA, nas mais diversas áreas, acaba realizando apenas tarefas específicas ao contexto em que é aplicada. Cada sistema criado é limitado a um conjunto de atividades de cada finalidade: um bot. (diminutivo de robot) de atendimento vai trabalhar com ofertas de produtos, responder a dúvidas, negociar dívidas mas esse mesmo bot. não vai conseguir jogar xadrez ou guiar um veículo autônomo, por exemplo, já que não consegue elaborar estratégias funcionais e sim apenas executar comandos com base em alguma análise de dados relativa à sua função. Um sistema tão complexo e abrangente como o cérebro humano ainda é uma realidade distante. Os extraordinários avanços da neurociência mostram que o ser-humano ainda está longe de compreender alguns mistérios do cérebro humano, entre eles, a incrível capacidade de criar, destruir e refinar ideias, ou seja, a criatividade. A IA é mais competente do que as pessoas em tarefas de análise, organização e até resolução de alguns problemas, mas ainda não é capaz de melhorar a si mesma, em diversos campos, e aprender coisas novas sem informações prévias. Grandes empresas já estão trabalhando na chamada ‘deep learning’ (aprendizagem profunda), um dos mais promissores campos da IA, que pretende fazer dos sistemas entidades capazes de aprender evolutivamente. Mas, ainda não é possível, e talvez nunca será, eliminar o fator humano, entre outros pontos, da própria avaliação de progresso dessa disciplina tecnológica.

Inteligência Artificial eliminará todos os cargos de trabalho[editar | editar código-fonte]

Um sistema que utiliza inteligência artificial pode armazenar e analisar bilhões de dados, realizar automaticamente tarefas com base nessa análise, fechar acordos, vender, controlar uma linha de produção etc., mas não é capaz de criar estratégias do zero. Além disso, tudo o que envolve humanização, sentimentos como empatia ou características como dedicação, mesmo em um contexto onde a IA se espalhe, ainda dependerá de uma interação entre o homem e a máquina. Empregos como os conhecemos hoje se transformarão, muitos inclusive deixarão de existir, mas tantos outros novos surgirão.

Inteligência Artificial mudará o mundo em poucos anos[editar | editar código-fonte]

Apesar de uma grande porcentagem das funções terem parte de seus processos automatizada, nos dias de hoje, menos de 10% das atividades podem ser inteiramente substituídas por tecnologia. Nas indústrias haverá uma ampla troca da mão-de-obra humana pela força de trabalho de organismos robóticos e programas de computador que possam executar, automaticamente, tarefas repetitivas sem qualquer tipo de adversidade, já que não sofrem com todas as vulnerabilidades que um ser-humano detém como cansaço, riscos de sofrer acidentes e mobilidade, além do fato de não gerar despesas para a organização a não ser com sua manutenção e funcionamento. Porém, como se trata de um ramo da ciência relativamente novo e que está em uma fase de desenvolvimento lenta e gradual, ainda pode demorar para que a inteligência artificial cause algum impacto, realmente, significativo para as relações dentro da sociedade.

Abordagens[editar | editar código-fonte]

Não existe uma teoria ou paradigma unificador que orienta a pesquisa de IA. Pesquisadores discordam sobre várias questões.[11] Algumas das perguntas constantes mais longas que ficaram sem resposta são as seguintes: a inteligência artificial deve simular inteligência natural, estudando psicologia ou neurociência? Ou será que a biologia humana é tão irrelevante para a pesquisa de IA como a biologia das aves é para a engenharia aeronáutica? O comportamento inteligente pode ser descrito usando princípios simples e elegantes (como lógica ou otimização)? Ou ela necessariamente requer que se resolva um grande número de problemas completamente não relacionados? A inteligência pode ser reproduzida usando símbolos de alto nível, similares às palavras e ideias? Ou ela requer processamento "sub-simbólico?" John Haugeland, que cunhou o termo GOFAI (Good Old-Fashioned Artificial Intelligence - Boa Inteligência Artificial à Moda Antiga), também propôs que a IA deve ser mais apropriadamente chamada de inteligência sintética, um termo que já foi adotado por alguns pesquisadores não-GOFAI.[12][13]

Cibernética e simulação cerebral[editar | editar código-fonte]

Nos anos de 1940 e 1950, um número de pesquisadores exploraram a conexão entre neurologia, teoria da informação e cibernética. Alguns deles construíram máquinas que usaram redes eletrônicas para exibir inteligência rudimentar, como as tartarugas de W. Grey Walter e a Besta de Johns Hopkins. Muitos desses pesquisadores se reuniram para encontros da Sociedade teleológica da Universidade de Princeton e o Ratio Club na Inglaterra. Em 1960, esta abordagem foi abandonada, apesar de seus elementos serem revividos na década de 1980.

Sub-simbólica[editar | editar código-fonte]

- Inteligência computacional

Interesse em redes neurais e "conexionismo" foi revivida por David Rumelhart e outros em meados de 1980. Estas e outras abordagens sub-simbólicas, como sistemas de fuzzy e computação evolucionária, são agora estudados coletivamente pela disciplina emergente inteligência computacional.

IA forte e IA fraca[editar | editar código-fonte]

Entre os teóricos que estudam o que é possível fazer com a IA existe uma discussão onde se consideram duas propostas básicas: uma conhecida como "forte" e outra conhecida como "fraca". Basicamente, a hipótese da IA forte considera ser possível criar uma máquina consciente, ou seja, afirma que os sistemas artificiais devem replicar a mentalidade humana.[14]

Inteligência artificial forte[editar | editar código-fonte]

A investigação em Inteligência Artificial Forte aborda a criação da forma de inteligência baseada em computador que consiga raciocinar e resolver problemas; uma forma de IA forte é classificada como auto-consciente.

A IA forte é tema bastante controverso, pois envolve temas como consciência e fortes problemas éticos ligados ao que fazer com uma entidade que seja cognitivamente indiferenciável de seres humanos.

A ficção científica tratou de muitos problemas desse tipo. Isaac Asimov, por exemplo, escreveu O Homem Bicentenário, onde um robô consciente e inteligente luta para possuir um status semelhante ao de um humano na sociedade.[15] E Steven Spielberg dirigiu "A.I. Inteligência Artificial" onde um garoto-robô procura conquistar o amor de sua "mãe", procurando uma maneira de se tornar real. Por outro lado, o mesmo Asimov reduz os robôs a servos dos seres humanos ao propor as três leis da robótica.[8]

Stephen Hawking alertou sobre os perigos da inteligência artificial e considerou uma ameaça à sobrevivência da humanidade.[16]

Inteligência artificial fraca[editar | editar código-fonte]

Trata-se da noção de como lidar com problemas não determinísticos.

Uma contribuição prática de Alan Turing foi o que se chamou depois de Teste de Turing (TT),[17] de 1950: em lugar de responder à pergunta "podem-se ter computadores inteligentes?" ele formulou seu teste, que se tornou praticamente o ponto de partida da pesquisa em "Inteligência Artificial".[5]

O teste consiste em se fazer perguntas a uma pessoa e um computador escondidos. Um computador e seus programas passam no TT se, pelas respostas, for impossível a alguém distinguir qual interlocutor é a máquina e qual é a pessoa.

No seu artigo original ele fez a previsão de que até 2000 os computadores passariam seu teste.[17] Pois bem, há um concurso anual de programas para o TT, e o resultado dos sistemas ganhadores é tão fraco (o último tem o nome "Ella") que com poucas perguntas logo percebe-se as limitações das respostas da máquina. É interessante notar que tanto a Máquina de Turing quanto o Teste de Turing talvez derivem da visão que Turing tinha de que o ser humano é uma máquina.

Há quem diga que essa visão está absolutamente errada, do ponto de vista lingüístico, já que associamos à "máquina" um artefato inventado e eventualmente construído. Dizem eles: "Nenhum ser humano foi inventado ou construído". Afirma-se ainda que a comparação, feita por Turing, entre o homem e a máquina é sinônimo de sua "ingenuidade social", pois as máquinas são infinitamente mais simples do que o homem, apesar de, paradoxalmente, se afirmar que a vida é complexa. No entanto, esta linha de raciocínio é questionável, afinal de contas, os computadores modernos podem ser considerados "complexos" quando comparados ao COLOSSUS (computador cujo desenvolvimento foi liderado por Turing, em 1943), ou a qualquer máquina do início do século XX.

A inteligência artificial fraca centra a sua investigação na criação de inteligência artificial que não é capaz de verdadeiramente raciocinar e resolver problemas. Uma tal máquina com esta característica de inteligência agiria como se fosse inteligente, mas não tem autoconsciência ou noção de si. O teste clássico para aferição da inteligência em máquinas é o Teste de Turing.[17]

Há diversos campos dentro da IA fraca, e um deles é o Processamento de linguagem natural, que trata de estudar e tentar reproduzir os processos de desenvolvimento que resultaram no funcionamento normal da língua. Muitos destes campos utilizam softwares específicos e linguagens de programação criadas para suas finalidades. Um exemplo bastante conhecido é o programa A.L.I.C.E. (Artificial Linguistic Internet Computer Entity, ou Entidade Computadorizada de Linguagem Artificial para Internet), um software que simula uma conversa humana. Programado em Java e desenvolvido com regras heurísticas para os caracteres de conversação, seu desenvolvimento resultou na AIML (Artificial Intelligence Markup Language), uma linguagem específica para tais programas e seus vários clones, chamados de Alicebots.

Muito do trabalho neste campo tem sido feito com simulações em computador de inteligência baseado num conjunto predefinido de regras. Poucos têm sido os progressos na IA forte. Mas dependendo da definição de IA utilizada, pode-se dizer que avanços consideráveis na IA fraca já foram alcançados.

Impossibilidade de Simulação Qualitativa[editar | editar código-fonte]

Foi provado que um simulador qualitativo, completo e robusto não pode existir, ou seja, desde que o vocabulário entrada-saída seja usado (como num algoritmo QSIM), haverá sempre modelos de entrada que causam predições erradas na sua saída. Por exemplo, a noção de infinito é impossível ser tida por uma máquina finita (computador ou neurónios se produzirem apenas um número finito de resultados num número finito de tempo). Neste caso é um simples paradoxo matemático, porque são em número finito as combinações saídas de qualquer conjunto finito. Se a noção de infinito pudesse ser obtida por uma certa combinação finita, isso significaria que o infinito seria equivalente a essa sequência finita, o que é obviamente uma contradição. Por isso, o infinito e outras noções abstractas têm que ser pré-adquiridas numa máquina finita, não são aí programáveis. [18],[19]

Críticas filosóficas e a argumentação de uma IA forte[editar | editar código-fonte]

Muitos filósofos, sobretudo John Searle e Hubert Dreyfus, inseriram no debate questões de ordem filosófica e epistemológica, questionando qualquer possibilidade efetiva da IA forte.[20][21] Seriam falsos, assim, os próprios pressupostos da construção de uma inteligência ou consciência semelhante à humana em uma máquina.[22]

Searle é bastante conhecido por seu contra-argumento sobre o Quarto Chinês (ou Sala Chinesa), que inverte a questão colocada por Minsky a respeito do Teste de Turing.[23] Seu argumento diz que ainda que uma máquina possa parecer falar chinês por meio de recursos de exame comparativo com mostras e tabelas de referência, binárias, isso não implica que tal máquina fale e entenda efetivamente a língua. Ou seja, demonstrar que uma máquina possa passar no Teste de Turing não necessariamente implica um ser consciente, tal como entendido em seu sentido humano.[24] Dreyfus, em seu livro O que os computadores ainda não conseguem fazer: Uma crítica ao raciocínio artificial, argumenta que a consciência não pode ser adquirida por sistemas baseados em regras ou lógica; tampouco por sistemas que não façam parte de um corpo físico. No entanto, este último autor deixa aberta a possibilidade de um sistema robótico baseado em Redes Neuronais, ou em mecanismos semelhantes, alcançar a inteligência artificial.[21]

Mas já não seria a referida IA forte, mas sim um correlato bem mais próximo do que se entende por IA fraca. Os revezes que a acepção primeira de Inteligência Artificial vem levando nos últimos tempos contribuíram para a imediata relativização de todo seu legado. O papel de Marvin Minsky, figura proeminente do MIT e autor de Sociedade da Mente, fora central para a acepção de uma IA linear que imitaria com perfeição a mente humana, mas seu principal feito foi construir o primeiro computador baseado em redes neurais, conhecido como Snark,[25] tendo simplesmente fracassado pois nunca executou qualquer função interessante, apenas consumiu recursos de outras pesquisas mais promissoras. O primeiro neuro computador a obter sucesso (Mark I Perceptron) surgiu em 1957 e 1958, criado por Frank Rosenblatt, Charles Wightman e outros. Atualmente, no entanto, as vertentes que trabalham com os pressupostos da emergência e com elementos da IA fraca parecem ter ganhado proeminência do campo.

As críticas sobre a impossibilidade de criar uma inteligência em um composto artificial podem ser encontradas em Jean-François Lyotard (O Pós-humano) e Lucien Sfez (Crítica da Comunicação); uma contextualização didática do debate encontra-se em Sherry Turkle (O segundo Eu: os computadores e o espírito humano). Pode-se resumir o argumento central no fato de que a própria concepção de inteligência é humana e, nesse sentido, animal e biológica. A possibilidade de transportá-la para uma base plástica, artificial, encontra um limite claro e preciso: se uma inteligência puder ser gerada a partir destes elementos, deverá ser necessariamente diferente da humana, na medida em que o seu resultado provém da emergência de elementos totalmente diferentes dos encontrados nos humanos. A inteligência, tal como a entendemos, é essencialmente o fruto do cruzamento da uma base biológica com um complexo simbólico e cultural, impossível de ser reproduzido artificialmente.

Outros filósofos sustentam visões diferentes. Ainda que não vejam problemas com a IA fraca, entendem que há elementos suficientes para se crer na IA forte também. Daniel Dennett argumenta em Consciência Explicada que se não há uma centelha mágica ou alma nos seres humanos, então o Homem é apenas uma outra máquina. Dennett questiona por que razão o Homem-máquina deve ter uma posição privilegiada sobre todas as outras possíveis máquinas quando provido de inteligência.

Alguns autores sustentam que se a IA fraca é possível, então também o é a forte. O argumento da IA fraca, de uma inteligência imitada mas não real, desvelaria assim uma suposta validação da IA forte. Isso se daria porque, tal como entende Simon Blackburn em seu livro Think, dentre outros, não existe a possibilidade de verificar se uma inteligência é verdadeira ou não. Estes autores argumentam que toda inteligência apenas parece inteligência, sem necessariamente o ser. Parte-se do princípio que é impossível separar o que é inteligência de fato do que é apenas simulação: apenas acredita-se ser.

Estes autores rebatem os argumentos contra a IA forte dizendo que seus críticos reduzem-se a arrogantes que não podem entender a origem da vida sem uma centelha mágica, um Deus ou uma posição superior qualquer. Eles entenderiam, em última instância, máquina como algo essencialmente incapaz e sequer conseguem supô-la como capaz de inteligência. Nos termos de Minsky, a crítica contra a IA forte erra ao supor que toda inteligência derive de um sujeito - tal como indicado por Searle - e assim desconsidera a possibilidade de uma maquinaria complexa que pudesse pensar. Mas Minsky desconsidera o simples fato de que os maiores avanços na área foram conseguidos com "maquinaria complexa", também chamada por pesquisadores mais importantes de Inteligência Artificial Conexista. Se a crítica de Minsky fosse válida a maquina criada por Rosenblatt e Bernard Widrow não estaria em uso ainda hoje, e o Mark I Perceptron não seria o fundador da neuro-computação. Alguns pesquisadores importantes afirmam que um dos motivos das críticas de Minsky foi o fato de ter falhado com Snark. A partir daí começou a criticar essa área por não compreende-la completamente, prejudicando desde então pesquisas importantes sobre o assunto.

O debate sobre a IA reflete, em última instância, a própria dificuldade da ciência contemporânea em lidar efetivamente com a ausência de um primado superior. Os argumentos pró-IA forte são esclarecedores dessa questão, pois são os próprios cientistas, que durante décadas tentaram e falharam ao criar uma IA forte, que ainda procuram a existência de uma ordem superior. Ainda que a IA forte busque uma ordem dentro da própria conjugação dos elementos internos, trata-se ainda da suposição de que existe na inteligência humana uma qualidade superior que deve ser buscada, emulada e recriada. Reflete, assim, a difícil digestão do legado radical da Teoria da Evolução, onde não existe positividade alguma em ser humano e ser inteligente; trata-se apenas de um complexo de relações que propiciaram um estado particular, produto de um cruzamento temporal entre o extrato biológico e uma complexidade simbólica.

História[editar | editar código-fonte]

O conceito de inteligência artificial não é contemporâneo. Aristóteles, professor de Alexandre, o Grande, almejava substituir a mão-de-obra escrava por objetos autônomos, sendo essa a primeira idealização de Inteligência Artificial relatada, uma ideia que seria explorada muito tempo depois pela ciência da computação. O desenvolvimento dessa ideia se deu de forma plena no Século XX, com enfoque nos anos 50, com pensadores como Herbert Simon e John McCarthy. Os primeiros anos da IA foram repletos de sucessos – mas de uma forma limitada. Considerando-se os primeiros computadores, as ferramentas de programação da época e o fato de que apenas alguns anos antes os computadores eram vistos como objetos capazes de efetuar operações aritméticas e nada mais, causava surpresa o fato de um computador realizar qualquer atividade remotamente inteligente.

O sucesso inicial prosseguiu com o General Problem Solver (Solucionador de problemas gerais) ou GPS, desenvolvido por Newell e Simon.[26] Esse programa foi projetado para imitar protocolos humanos de resolução de problemas. Dentro da classe limitada de quebra-cabeças com a qual podia lidar, verificou-se que a ordem em que os seres humanos abordavam os mesmos problemas. Desse modo, o GPS talvez tenha sido o primeiro programa a incorporar a abordagem de “pensar de forma humana”.

Desde o início os fundamentos da inteligência artificial tiveram o suporte de várias disciplinas que contribuíram com ideias, pontos de vista e técnicas para a IA. Os filósofos (desde 400 a.C.) tornaram a IA concebível, considerando as ideias de que a mente é, em alguns aspectos, semelhante a uma máquina, de que ela opera sobre o conhecimento codificado em alguma linguagem interna e que o pensamento pode ser usado para escolher as ações que deverão ser executadas. Por sua vez, os matemáticos forneceram as ferramentas para manipular declarações de certeza lógica, bem como declarações incertas e probabilísticas. Eles também definiram a base para a compreensão da computação e do raciocínio sobre algoritmos.

Os economistas formalizaram o problema de tomar decisões que maximizam o resultado esperado para o tomador de decisões. Os psicólogos adotaram a ideia de que os seres humanos e os animais podem ser considerados máquinas de processamento de informações. Os lingüistas mostraram que o uso da linguagem se ajusta a esse modelo. Os engenheiros de computação fornecem os artefatos que tornam possíveis as aplicações de IA. Os programas de IA tendem a ser extensos e não poderiam funcionar sem os grandes avanços em velocidade e memória que a indústria de informática tem proporcionado.

Atualmente, a IA abrange uma enorme variedade de subcampos. Dentre esses subcampos está o estudo de modelos conexionistas ou redes neurais. Uma rede neural pode ser vista como um modelo matemático simplificado do funcionamento do cérebro humano.[27] Este consiste de um número muito grande de unidades elementares de processamento, ou neurônios, que recebem e enviam estímulos elétricos uns aos outros, formando uma rede altamente interconectada.

No processamento, são compostos os estímulos recebidos conforme a intensidade de cada ligação, produzindo um único estímulo de saída. É o arranjo das interconexões entre os neurônios e as respectivas intensidades que define as principais propriedades e o funcionamento de uma RN. O estudo das redes neurais ou o conexionismo se relaciona com a capacidade dos computadores aprenderem e reconhecerem padrões. Podemos destacar também o estudo da biologia molecular na tentativa de construir vida artificial e a área da robótica, ligada à biologia e procurando construir máquinas que alojem vida artificial. Outro subcampo de estudo é a ligação da IA com a Psicologia, na tentativa de representar na máquina os mecanismos de raciocínio e de procura.

Nos últimos anos, houve uma revolução no trabalho em inteligência artificial, tanto no conteúdo quanto na metodologia. Agora, é mais comum usar as teorias existentes como bases, em vez de propor teorias inteiramente novas, fundamentar as informações em teoremas rigorosos ou na evidência experimental rígida, em vez de utilizar como base a intuição e destacar a relevância de aplicações reais em vez de exemplos de brinquedos.

A utilização da IA permite obter não somente ganhos significativos de performance, mas também possibilita o desenvolvimento de aplicações inovadoras, capazes de expandir de forma extraordinária nossos sentidos e habilidades intelectuais. Cada vez mais presente, a inteligência artificial simula o pensamento humano e se alastra por nosso cotidiano. Em maio de 2017 no Brasil, foi criada a ABRIA (Associação Brasileira de Inteligência Artificial) com o objetivo de mapear iniciativas brasileiras no setor de inteligência artificial, englobando os esforços entre as empresas nacionais e formação de mão de obra especializada. Esse passo reforça que, atualmente, a inteligência artificial é impactante no setor econômico.

Investigação na IA experimental[editar | editar código-fonte]

A inteligência artificial começou como um campo experimental nos anos 50 com pioneiros como Allen Newell e Herbert Simon, que fundaram o primeiro laboratório de inteligência artificial na Universidade Carnegie Mellon, e McCarty que juntamente com Marvin Minsky, que fundaram o MIT AI Lab em 1959. Foram eles alguns dos participantes na famosa conferência de verão de 1956 em Darthmouth College.[28]

Historicamente, existem dois grandes estilos de investigação em IA: IA "neats" e IA "scruffies". A IA "neats", limpa, clássica ou simbólica. Envolve a manipulação de símbolos e de conceitos abstractos, e é a metodologia utilizada na maior parte dos sistemas periciais.

Paralelamente a esta abordagem existe a abordagem IA "scruffies", ou "coneccionista", da qual as redes neuronais são o melhor exemplo. Esta abordagem cria sistemas que tentam gerar inteligência pela aprendizagem e adaptação em vez da criação de sistemas desenhados com o objectivo especifico de resolver um problema. Ambas as abordagems apareceram num estágio inicial da história de IA. Nos anos 60s e 70s os coneccionistas foram retirados do primeiro plano da investigação em IA, mas o interesse por esta vertente da IA foi retomada nos anos 80s, quando as limitações da IA "limpa" começaram a ser percebidas.

Pesquisas sobre inteligência artificial foram intensamente custeadas na década de 1980 pela Agência de Projetos de Pesquisas Avançadas sobre Defesa (“Defense Advanced Research Projects Agency”), nos Estados Unidos, e pelo Projeto da Quinta Geração (“Fifth Generation Project”), no Japão. O trabalho subsidiado fracassou no sentido de produzir resultados imediatos, a despeito das promessas grandiosas de alguns praticantes de IA, o que levou proporcionalmente a grandes cortes de verbas de agências governamentais no final dos anos 80, e em conseqüência a um arrefecimento da atividade no setor, fase conhecida como O inverno da IA. No decorrer da década seguinte, muitos pesquisadores de IA mudaram para áreas relacionadas com metas mais modestas, tais como aprendizado de máquinas, robótica e visão computacional, muito embora pesquisas sobre IA pura continuaram em níveis reduzidos.

Resoluções de problemas com IA[editar | editar código-fonte]

Uma das áreas mais estudadas por cientistas sobre Inteligência Artificial, é o processo de Resolução de Problemas, desde os mais simples até os mais complexos. Com base no estudos de comportamentos de indivíduos que resolvem problemas simples em laboratório, Allen Newell e Herbert Simon desenvolveram alguns programas para simular aspectos do comportamento inteligente e racional. Um de seus principais programas desenvolvidos, chamado 'General Problem Solver' (Solucionador de Problemas Gerais) pode ser resumido em poucas etapas: a primeira etapa consiste em gravar as declarações realizadas por alguns indivíduos que verbalizam seu pensamento enquanto resolvem os problemas. A seguir, o teórico ensaia algumas hipóteses acerca dos processos mentais que possivelmente estariam envolvidos no processo de elaboração de uma solução para o problema dado. A partir dessas hipóteses ele estrutura um programa que, em sua opinião, simulará o relato gravado. Finalmente, após processar esse programa no computador digital, ele compara o relato do indivíduo com o roteiro da máquina. Se os fluxos de palavras registrados no roteiro e no relatório forem razoavelmente semelhantes, então considera-se que uma explicação para o comportamento sob estudo foi obtida. Os pesquisadores do Projeto de Simulação Cognitiva admitem, neste caso, que as estratégias utilizadas pelo computador são análogas àquelas realizadas pelo indivíduo humano. Caso contrário, o programa deverá ser modificado com base nas discrepâncias encontradas durante o confronto de palavras. O mesmo procedimento é repetido até que um ajuste satisfatório seja obtido e o programa consiga passar pelo teste de Turing. Ou seja, até que os fluxos de palavras produzidas pelo computador e pelo sujeito humano sejam praticamente indistinguíveis para um examinador humano. [29]

Abordagens[editar | editar código-fonte]

Não há uma teoria ou paradigma unificado estabelecido que guie a pesquisa em IA. Os pesquisadores discordam em muitas questões.[31] Algumas das questões mais duradouras que permaneceram sem respostas são essas: a inteligência artificial poderia simular a inteligência natural, através do estudo da psicologia ou neurologia? Ou a biologia humana é tão irrelevante à pesquisa de IA quando a biologia de um pássaro é para a engenharia aeronáutica? O comportamento inteligente pode ser descrito usando simples princípios elegantes (tais como lógica ou otimização)? Ou faz-se necessário resolver um grande número de problemas completamente não-relacionados? A inteligência pode ser reproduzida utilizando-se símbolos de alto nível, semelhante à palavras e ideias? Ou faz-se necessário o processamento "sub-simbólico"?[32]

Aplicações Práticas de Técnicas de IA[editar | editar código-fonte]

Enquanto que o progresso direcionado ao objetivo final de uma inteligência similar à humana tem sido lento, muitas derivações surgiram no processo. Exemplos notáveis incluem as linguagens Lisp e Prolog, as quais foram desenvolvidas para pesquisa em IA,[33] embora também sejam usadas para outros propósitos. A cultura hacker surgiu primeiramente em laboratórios de IA, em particular no MIT AI Lab, lar várias vezes de celebridades tais como McCarthy, Minsky, Seymour Papert (que desenvolveu a linguagem Logo), Terry Winograd(que abandonou IA depois de desenvolver SHRDLU).

Muitos outros sistemas úteis têm sido construídos usando tecnologias que ao menos uma vez eram áreas ativas em pesquisa de IA. Alguns exemplos incluem:

- Planejamento automatizado e escalonamento: a uma centena de milhões de quilômetros da Terra, o programa Remote Agent da NASA se tornou o primeiro programa de planejamento automatizado (autônomo) de bordo a controlar o escalonamento de operações de uma nave espacial. O Remote Agent gerou planos de metas de alto nível especificadas a partir do solo e monitorou a operação da nave espacial à medida que os planos eram executados – efetuando a detecção, o diagnóstico e a recuperação de problemas conforme eles ocorriam.

- Aplicações de Raciocínio baseado em casos: RBC tem sido utilizado em diversas aplicações como análise financeira, assessoramento de riscos, controle de processos, etc. Exemplos de aplicações de RBC incluem KRITIK,[34] o CLAVIER na Lockheed,[35] o CASELine na British Airways,[35] PROTOS, CASEY, CASCADE, COMPOSER, etc..[36]

- Aplicações de Algoritmos genéticos: AG são aplicáveis em diversos problemas como escalonamento de horários, sistemas de potência e filogenética.[37] O CS-1 foi o primeiro sistema de classificação aplicando AG.[38]

- Jogos: o Deep Blue da IBM se tornou o primeiro programa de computador a derrotar o campeão mundial em uma partida de xadrez, ao vencer Garry Kasparov por um placar de 3,5 a 2,5 em um match de exibição em 1996.[39][40] Kasparov disse que sentiu “uma nova espécie de inteligência” do outro lado do tabuleiro. O valor das ações da IBM teve um aumento de 18 bilhões de dólares. Ainda hoje há indícios que o jogo foi armado, pois a IBM negou-se a entregar os logs sobre o jogo, especialistas afirmam que na verdade o jogo foi uma farsa, pois não era a maquina que estava jogando e sim uma equipe de especialistas em xadrez.

- Controle autônomo: o sistema de visão de computador ALVINN foi treinado para dirigir um automóvel, mantendo-o na pista. Ele foi colocado na minivan controlada por computador NAVLAB da CMU e foi utilizado para percorrer os Estados Unidos – ao longo de quase 4.600 km o ALVINN manteve o controle da direção do veículo durante 98% do tempo. Um ser humano assumiu o comando nos outros 2%, principalmente na saída de declives. A NAVLAB tem câmeras e vídeo que transmitem imagens da estrada para ALVINN, que então calcula a melhor forma de guiar, baseado na experiência obtida em sessões de treinamento anteriores.

- Diagnóstico: programas de diagnóstico medico baseados na analise probabilística foram capazes de executar tarefas no nível de um medico especialista em diversas áreas da medicina. Heckerman (1991) descreve um caso em que um importante especialista em patologia de gânglios linfáticos ridiculariza o diagnóstico de um programa em um caso especialmente difícil. Os criadores do programa sugeriram que ele pedisse ao computador uma explicação do diagnóstico. A máquina destacou os principais fatores que influenciaram sua decisão e explicou a interação sutil de vários sintomas nesse caso. Mais tarde, o especialista concordou com o programa.

- Planejamento logístico: durante a crise do Golfo Pérsico em 1991, as forças armadas dos Estados Unidos distribuíram uma ferramenta denominada Dynamic Analysis and Replanning Tool, ou DART, a fim de realizar o planejamento logístico automatizado e a programação de execução do transporte. Isso envolveu até 50 000 veículos, transporte de carga aérea e de pessoal ao mesmo tempo, e teve de levar em conta os pontos de partida, destinos, rotas e resolução de conflitos entre todos os parâmetros. As técnicas de planejamento da IA permitiram a geração em algumas horas de um plano que exigiria semanas com outros métodos. A Defense Advanced Research Project Agency (DARPA) declarou que essa única aplicação compensou com folga os 30 anos de investimentos da DARPA em IA.

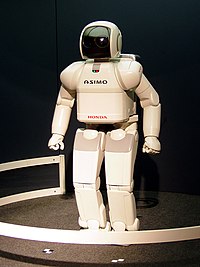

- Robótica: muitos cirurgiões agora utilizam robôs assistentes em microcirurgias. O HipNav é um sistema que emprega técnicas de visão computacional para criar um modelo tridimensional da anatomia interna de um paciente, e depois utiliza controle robótico para orientar a inserção de uma prótese de substituição do quadril.

- Reconhecimento de linguagem e resolução de problemas: o PROVERB é um programa computador que resolve quebra-cabeças de palavras cruzadas melhor que a maioria dos seres humanos, utilizando restrições sobre possíveis preenchimentos de palavras, um grande banco de dados de quebra-cabeças anteriores e uma variedade fonte de informações que incluem dicionários e bancos de dados on-line, como uma lista de filmes e dos atores que participam deles.[41] Por exemplo, ele descobre que a pista “Nice Story” pode ser resolvido por “ETAGE”, porque seu banco de dados inclui o par pista/solução ”Story in France/ETAGE” e porque reconhece que os padrões “Nice X” e “X in France” com freqüência tem mesma solução. O programa não sabe que Nice é uma cidade da França, mas consegue resolver o quebra-cabeça. * Chinook foi declarado o campeão Homem-Máquina em Damas em 1994.

- Lógica incerta, uma técnica para raciocinar dentro de incertezas, tem sido amplamento usada em sistemas de controles industriais.[42]

- Sistemas especialistas vêm sendo usados a uma certa escala industrial. Os sistemas especialistas foram um dos primeiros sucessos da IA, com o software Mycin.[43] Os principais componentes de um Sistema especialista são uma base de conhecimento alimentada por um especialista, uma máquina de inferência e uma memória de trabalho.[44]Sistemas especialistas em uso como o XCON/R1 da Digital Equipment Coporation sabem hoje muito mais do que um especialista humano em como configurar os seus sistemas de computação.[45]

- Sistemas Tutoriais Inteligentes vem sendo usados para o aprendizado.[46] Uma característica distintiva desta técnica é o modelo do estudante.[47][48] * Sistemas tradutores, tais como SYSTRAN,[49] têm sido largamente usados (no entanto, os resultados não são ainda comparáveis com tradutores humanos).

- Redes Neurais vêm sendo usadas em uma larga variedade de tarefas, de Sistema de detecção de intrusos a jogos de computadores.

- Sistemas de reconhecimento óptico de caracteres (OCR) podem traduzir letra escrita de forma arbitrária em texto.

- Reconhecimento de escrita a mão é usada em muitos Assistentes Pessoais Digitais. Atualmente existe um sistema de comparação de escrita forense a mão chamado CEDAR-FOX.[50] * Reconhecimento de voz está disponível comercialmente e é amplamente usado.

- Sistemas de álgebra computacional, tais como Mathematica e Macsyma, são bons exemplos de aplicações de IA na solução de problemas algébricos.[51]

- Sistemas com Visão computacional são usados em muitas aplicações industriais.

- Aplicações utilizando Vida Artificial são utilizados na indústria de entretenimento e no desenvolvimento da Computação Gráfica.

- Sistemas baseados na ideia de agentes artificiais, denominados Sistemas Multiagentes, têm se tornado comuns para a resolução de problemas complexos.[52]

- Chatterbots (robôs de software para conversação), personagens virtuais que conversam em linguagem natural como se fossem humanos de verdade, são cada vez mais comuns na internet.[53]

- Compliance & Mitigação de riscos, empresas como Experian, Dun and Bradstreet, Equifax, LexisNexis, UpLexis, Montax Big Data e eStracta utilizam IA na análise do risco de contratações a partir de consultas automáticas de megadados sobre pessoas e organizações disponíveis em bancos de dados públicos e privados.

- Aplicação na área da saúde, a introdução na medicina com a criação da IAM (Inteligência artificial na Medicina) propôs a ajuda mútua entre profissionais da saúde e da computação com a ideia de realizarem uma revolução na área médica. A partir dos anos 70 e 80, grandes universidades americanas iniciaram projetos para auxiliar no processo de diagnósticos, como MIT, Tufts University, Pittsburgh, entre outras. Esses programas rapidamente atraíram vários dos melhores cientistas da época, com os primeiros anos da realização dos projetos sendo até hoje referências na história da IAM, por terem sido extremamente ricos e produtivos.

A visão da Inteligência Artificial substituindo julgamento humano profissional tem surgido muitas vezes na história do campo, em ficção científica e, hoje em dia, em algumas áreas especializadas onde "Sistemas Especialistas" são usados para melhorar ou para substituir julgamento profissional em engenharia e medicina, por exemplo.

Vantagens e Desvantagens da utilização da inteligência artificial[editar | editar código-fonte]

Vantagens[editar | editar código-fonte]

- Redução de erros: Uma vez que são máquinas, a inteligência artificial é mais resistente e tem maior capacidade de suportar ambientes hostis, reduzindo as chances de falharem em seus propósitos, tendo a possibilidade de alcançar um maior grau de precisão.

- Exploração: Devido à programação dos robôs, eles podem realizar um trabalho mais laborioso e duro com maior responsabilidade. Assim, são capazes de ser utilizadas também em processos de exploração de minérios e de outros combustíveis, no fundo do oceano e, portanto, superar as limitações humanas.

- Aplicações diárias: Inteligência Artificial é amplamente empregada por instituições financeiras e instituições bancárias para organizar e gerenciar dados. A sua utilização está presente em vários mecanismos do nosso cotidiano como o GPS (global positioning system), a correção nos erros de digitação na ortografia, entre outros.

- Sem pausas: As máquinas, ao contrário dos seres humanos, não precisam de intervalos frequentes. Ela conseguem exercer vários horas de trabalho sem ficarem cansadas, distraídas ou entendiadas, apenas pela sua programação.

Desvantagens[editar | editar código-fonte]

- Alto custo: o custo de produção das máquinas de IA são demasiados, o que se deve a complexidade e dificuldade de manutenção. O processo de recuperação de códigos perdidos, por exemplo, requer muito tempo e recursos.

- Falta de criatividade: A inteligência artificial não é desenvolvida ao ponto de atuar como o cérebro humano, de forma criativa. Ademais, o cérebro humano ainda não é suficientemente compreendido para que um dia possa ser simulado fielmente em uma forma artificial. Portanto, a ideia de replicar funções do cérebro humano é intangível.

- Causa o desemprego: Como são capazes de executar tarefas antes exclusivas aos humanos de maneira mais otimizada e eficiente, os mecanismos de inteligência artificial tendem a substituir a atividade humana em larga escala. O trabalho de uma máquina que possui inteligência artificial é, muitas vezes, mais viável que o trabalho humano, logo, a projeção de um crescimento no desemprego em função disso é coerente.

Pesquisadores de IA[editar | editar código-fonte]

Atualmente existem diversos pesquisadores de IA ao redor do mundo em várias instituições e companhias de pesquisa. Entre os muitos que fizeram contribuições significativas estão:

Alan Turing (1912-1954)[editar | editar código-fonte]

Foi um dos homens de maior importância não só para seu tempo, como para a atualidade. Com estudos que não só foram base para a existência da inteligência artificial, mas de quase todos os aparelhos eletrônicos já feitos. Criou seu famoso teste, o “Teste de Turing”, usado até hoje para descobrir o nível de inteligência de um programa de inteligência artificial. Esse teste não foi criado para analisar a capacidade de um computador de pensar por si mesmo, já que as máquinas são completamente incapazes disso, mas sim de identificar o quão bem ele pode imitar o cérebro humano.

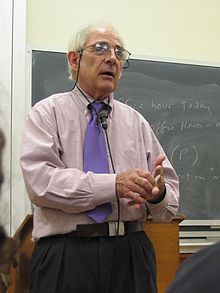

John McCarthy (1927-2011)[editar | editar código-fonte]

Matemático, cientista, o criador do termo “inteligência artificial” e também o pai da linguagem de programação LISP. McCarthy foi considerado um dos primeiros homens a trabalhar no desenvolvimento da inteligência artificial e sempre disse que ela deveria interagir com o homem. Nascido na cidade de Boston, trabalhou na Universidade de Stanford e no Massachusetts Institute of Technology (MIT), além de ter vencido o prêmio Turing em 1972 e a Medalha Nacional de Ciência em 1991. Já a programação LISP, uma das maiores conquistas de McCarthy, surgiu em 1958 e serviu para facilitar o desenvolvimento da inteligência artificial. A linguagem é das mais antigas ainda em uso e foi usada pela primeira vez ao colocar um computador para jogar xadrez contra um adversário humano.

Marvin Minsky (1927-2016)[editar | editar código-fonte]

Natural de Nova Iorque, onde nasceu, o cientista recebeu diversos prémios internacionais pelo seu trabalho pioneiro no campo da inteligência artificial, incluindo em 1969, o Prémio Turing, o maior prêmio em ciência informática. O cientista explorou a forma de dotar as máquinas de percepção e inteligência semelhantes à humana, criou mãos robóticas com capacidade para manipular objetos, desenvolveu novos marcos de programação e escreveu sobre assuntos filosóficos relacionados com a inteligência artificial. Minsky estava convencido de que o homem, um dia, desenvolveria máquinas que competiriam com a sua inteligência e via o cérebro como uma máquina cujo funcionamento pode ser estudado e reproduzido num computador, o que poderia ajudar a compreender melhor o cérebro humano e as funções mentais superiores.

Raj Reddy (1937)[editar | editar código-fonte]

Informático indiano naturalizado estadunidense, foi o primeiro asiático a vencer o Prêmio Turing. Entre suas contribuições para a IA estão a criação do Instituto de Robótica da CMUe demonstrações de diversos sistemas que usam alguma forma de IA. Entre esses sistemas, estão sistemas de: fala, controlados por voz, reconhecimento de voz, reconhecimento de voz independente do interlocutor, etc. Para Reddy, ao invés de substituir a humanidade, a tecnologia irá criar um novo tipo de humano que irá coexistir com seus antecessores enquanto se aproveita das vantagens de uma nova classe de ferramentas viabilizada pela tecnologia.

Terry Winograd (1946)[editar | editar código-fonte]

Winograd é um cientista da computação estadunidense, professor da Universidade Stanford, e co-diretor do grupo de interação humano-computador de Stanford. É conhecido nas áreas de filosofia da mente e inteligência artificial por seu trabalho sobre língua natural usando o programa SHRDLU. Para Terry, não restam dúvidas de que a tecnologia da informática, mais precisamente a área de inteligência artificial, transformará as sociedades, introduzindo modificações socioeconômicas irreversíveis. Esse especialista procura saber se os seres-humanos seriam capazes de construir máquinas que poderiam compreende-los, resolver seus problemas e dirigir suas vidas, além de buscar respostas sobre o que aconteceria se, algum dia, essas máquinas se tronassem mais inteligentes do que os próprios humanos que as criaram.

Douglas Lenat (1950)[editar | editar código-fonte]

Nascido na Filadélfia, Pensilvânia, se formou na Universidade da Pensilvânia. Douglas Bruce Lenat é o Diretor Executivo do Cycorp e foi também um pesquisador proeminente em inteligência artificial, recebendo o prêmio bianual IJCAI Computers and Thought em 1976 pela criação do programa de aprendizado de máquinas. Ele também trabalhou em simulações militares e em numerosos projetos para organizações governamentais, militares, científicas e de inteligência dos EUA. A missão de Lenat, no longo ciclo do projeto Cyc, iniciado em 1984, era de construir a base de uma inteligência artificial geral ao representar manualmente o conhecimento como axiomas lógicos contextualizados na linguagem formal com base em extensões ao cálculo de predicados de primeira ordem e em seguida, usar esse enorme motor de inferência de ontologia e a base de conhecimento contextualizada como um viés indutivo para automatizar e acelerar cada vez mais a educação contínua do próprio Cyc, via aprendizagem em máquina e compreensão da linguagem natural.

Ver também[editar | editar código-fonte]

Referências

- ↑ Andreas Kaplan; Michael Haenlein (2018) Siri, Siri in my Hand, who's the Fairest in the Land? On the Interpretations, Illustrations and Implications of Artificial Intelligence, Business Horizons, 62(1)

- ↑ Luger, George F (2004). Inteligência Artificial. Estruturas e Estratégias para a Solução de Problemas Complexos 4ª ed. Porto Alegre: Bookman. p. 23. 774 páginas. ISBN 85-363-0396-4

- ↑ Ir para:a b Rich, Elaine; Knight, Kevin (1994). Inteligência Artificial 2ª ed. Rio de Janeiro: McGraw-Hill. p. 3. 722 páginas. ISBN 85-346-0122-4

- ↑ Ir para:a b Vasconcelos, V.V.;Martins Junior, P.P. Protótipo de Sistema Especialista em Direito Ambiental para Auxílio à decisão em Situações de Desmatamento Rural. NT-27. CETEC-MG. 2004. 80p.

- ↑ Ir para:a b Alan Turing. «Computing Machinery and Intelligence» (em inglês). Consultado em 22 de maio de 2007

- ↑ István S. N. Berkeley. «What is Artificial Intelligence?»(em inglês). Consultado em 22 de maio de 2007

- ↑ J. McCarthy, M. L. Minsky, N. Rochester e C.E. Shannon. «A Proposal for the Dartmouth Summer Research Project on Artificial Intelligence» (em inglês). Consultado em 22 de maio de 2007

- ↑ Ir para:a b Bruce Mazlish. «The man-machine and artificial intelligence» (em inglês). Consultado em 22 de maio de 2007

- ↑ Felipe Cotias (17 de janeiro de 2015). «O Demônio de Mary Shelley». Ficções Humanas. Consultado em 6 de fevereiro de 2015

- ↑ Russell, Stuart; Norvig, Peter (2003). Artificial Intelligence. A Modern Approach (em inglês) 2ª ed. Upper Saddle River, New Jersey: Prentice Hall. p. 1-2. 1081 páginas. ISBN 0-13-790395-2

- ↑ Nils Nilsson escreveu: "Simplificando, há uma grande divergência no campo sobre o que IA é sobretudo" (Nilsson 1983, p. 10).

- ↑ http://citeseerx.ist.psu.edu/viewdoc/download?doi=10.1.1.38.8384&rep=rep1&type=pdf

- ↑ Pei Wang (2008). Artificial general intelligence, 2008: proceedings of the First AGI Conference. [S.l.]: IOS Press. p. 63. ISBN 978-1-58603-833-5. Consultado em 31 de outubro de 2011

- ↑ Coelho, Helder (1994). Inteligência Artificial em 25 Lições. Lisboa: Fundação Calouste Gulbenkian. p. 341. 532 páginas. ISBN 972-31-0679-5

- ↑ Asimov, Isaac (1992). The Complete Stories, Volume 2. [S.l.]: Doubleday. p. 568–604. ISBN 978-0385420785

- ↑ Cellan-Jones, Rory (20 de outubro de 2016). «Stephen Hawking - will AI kill or save?». BBC News (em inglês)

- ↑ Ir para:a b c Copeland, B. Jack (Editor); Turing, Alan (autor do artigo) (2004). «13-Can Digital Computers Think?». The Essential Turing. The Ideas that Gave Birth to the Computer Age (em inglês). Oxford: Clarendon Press, Oxford. 613 páginas. ISBN 0-19-825079-7

- ↑ Cem Say, A.C.; Levent Akın, H. (2003). «Sound and complete qualitative simulation is impossible.». Artificial Intelligence. 149 (2). p. 251-216

- ↑ Cem Say, A.C.; Yilmaz, O. (2006). «Causes of Ineradicable Spurious Predictions in Qualitative Simulation.». J. Artificial Intelligence Research. 27. p. 551-275

- ↑ Dreyfus, Hubert L (1972). What Computers Can't Do. A critique of artificial reason (em inglês). New York: Harper & Row. 259 páginas. ISBN 0-06011082-1

- ↑ Ir para:a b Dreyfus, Hubert L (1992). What Computers Still Can't Do. A Critique of Artificial Reason (em inglês). Cambridge: The MIT Press. 429 páginas. ISBN 978-0-26254067-4

- ↑ Genesereth, Michael R.; Nilsson, Nils J (1987). Logical Foundations of Artificial Intelligence. Los Altos, California: Morgan Kaufmann Publishers, Inc. p. 7. 405 páginas. ISBN 0-934613-31-1

- ↑ Searle, John L (1986). Minds, Brains, and Programs (em inglês). Cambridge, Massachusetts: Harvard University Press. 112 páginas. ISBN 978-0-67457633-9

- ↑ Noyes, James L (1992). Artificial Intelligence with Common Lisp. Fundamentals of Symbolic and Numeric Processing (em inglês). Lexington, Massachusetts: D. C. Heath. p. 534. 542 páginas. ISBN 0-669-19473-5

- ↑ Minsky, Marvin (1986). The Society of Mind (em inglês). New York: Touchstone. p. 76. 339 páginas. ISBN 0-671-65713-5

- ↑ Newell, Allen (autor do artigo); Simon, H. A (autor do artigo); Feigenbaum, Edward A. (editor); Feldman, Julian(editor) (1995). «Part 2. Section 1. GPS, A program that Simulates Human Thought». Computers & Thought(em inglês). Menlo Park, Cambridge: AAAI Press/MIT press. p. 279-296. 535 páginas. ISBN 0-262-56092-5

- ↑ Bose, N. K.; Liang, P (1996). Neural Network Fundamentals with Graphs, Algorithms, and Applications(em inglês). New York: McGraw-Hill. p. 5-8. 478 páginas. ISBN 0-07-006618-3

- ↑ Bittencourt, Guilherme (2001). Inteligência Artificial. Ferramentas e Teorias 2ª ed. Florianópolis: Editora da UFSC. p. 51. 362 páginas. ISBN 85-328-0138-2

- ↑ TEIXEIRA, J. de F. & QUILICI GONZALES, M.E. - Inteligência Artificial e teoria de resolução de problemas.http://www.scielo.br/pdf/trans/v6/v6a06.pdf

- ↑ http://www.scielo.br/pdf/trans/v6/v6a06.pdf

- ↑ Nilsson, Nils (1983). «Artificial Intelligence Prepares for 2001» (PDF). AI Magazine. 1 (1). ISSN 0738-4602

- ↑ Nilsson, Nils (1998). Artificial Intelligence: A New Synthesis. San Francisco: Morgan Kaufmann Publishers. p. 7. ISBN 978-1-55860-467-4

- ↑ Sebesta, Robert W (2010). Conceitos de Linguagens de Programação 9ª ed. Porto Alegre: Bookman. pp. 68–72;101–104;108–131. ISBN 978-85-7780-791-8

- ↑ Kolodner, Janet (1993). Case-Based Reasoning (em inglês). San Mateo, CA: Morgan Kaufmann. p. 11. 668 páginas. ISBN 1-55860-237-2

- ↑ Ir para:a b Watson, Ian (1997). Applying Case-Based Reasoning. Techniques for Enterprise Systems (em inglês). San Francisco, CA: Morgan Kaufmann. p. 66-89. 289 páginas. ISBN 1-55860-462-6

- ↑ von Wangenheim, Christiane Gresse; von Wangenheim, Aldo (2004). «10: Aplicações de RBC». Raciocínio Baseado em Casos. Barueri, SP: Manole. p. 227-241. 293 páginas. ISBN 85-204-1459-1

- ↑ Linden, Ricardo (2006). Algoritmos Genéticos. Uma importante ferramenta da Inteligência Computacional. Rio de Janeiro: Brasport. p. 285-312. 348 páginas. ISBN 85-7452-265-1

- ↑ Goldberg, David E. (1989). Genetic Algorithms in Search, Optimization, and Machine Learning. Reading, Massachusetts: Addison-Wesley. ISBN 0-201-15767-5

- ↑ Hsu, Feng-hsiung (2002). Behind Deep Blue: Building the Computer that Defeated the World Chess Champion. [S.l.]: Princeton University Press. ISBN 0-691-09065-3

- ↑ Davis, Martin (2000). Engines of Logic. Mathematicians and the Origin of the Computer (em inglês). New York: W. W. Norton. p. 203. 257 páginas. ISBN 0-393-32229-7

- ↑ «PROVERB: The Probabilistic Cruciverbalist». Consultado em 29 de janeiro de 2012

- ↑ Branco, Antonio Carlos Saraiva; Evsukoff, Alexandre Gonçalves (2004). «S-Sistema Neuro Fuzzy de Monitoramento e Diagnóstico de Falhas em Reatores Nucleares». Sistemas Inteligentes. Fundamentos e Aplicações. Barueri, SP: Manole. p. 449-452. ISBN 85-204-1683-7

- ↑ Harmon, Paul; King, David (1988). Sistemas Especialistas. A Inteligência Artificial Chega ao Mercado. Rio de Janeiro: Campus. p. 17-23. 304 páginas. ISBN 85-7001-430-9

- ↑ Durkin, John (1994). Expert Systems. Design and Development (em inglês). New York: Macmillan. p. 28-29. 800 páginas. ISBN 0-02-330970-9

- ↑ Giarratano, John; Riley, Gary (1998). Expert Systems. Principles and Programming (em inglês) 3ª ed. Boston: PWS Publishing Company. p. 6. 597 páginas. ISBN 0-534-95053-1

- ↑ Linton, Frank (autor); Boulay, B. du (editor); Mizoguchi, R. (editor) (1997). «Learning to Learn from an ITS». Artificial Intelligence in Education. Knowledge and Media in Learning Systems (em inglês). Amsterdam: IOS Press. p. 317-324. 685 páginas. ISBN 90-5199-353-6

- ↑ Sleeman, D.; Brown, J.S.(eds.) (1982). Intelligent Tutoring Systems (em inglês). Orlando: Academic Press Associates. 345 páginas. ISBN 0-12-648681-6

- ↑ Frasson, Claude; Gauthier, Gilles (eds.) (1990). «Student Modeling and Tutoring Flexibility in the Lisp Intelligent Tutoring System». Intelligent Tutoring Systems. At the crossroads of artificial intelligence and education (em inglês). Norwood, New Jersey: Ablex. p. 83-105. 291 páginas. ISBN 0-89391-625-0

- ↑ «Systran: Past and Present». Consultado em 29 de janeiro de 2012

- ↑ S. N. Srihari; Huang, C.; Srinivasan, H (março 2008). «On the Discriminability of the Handwriting of Twins». Journal of Forensic Sciences. 53 (2). p. 430-446. ISSN 1556-4029

- ↑ Norvig, Peter (1992). «8: Symbolic Mathematics: A Simplification Program». Paradigms of Artificial Intelligence Programming: Case Studies in Common Lisp(em inglês). San Francisco: Morgan Kauffmann. p. 238-261. 946 páginas. ISBN 1-55860-191-0

- ↑ Wooldridge, Michael (2002). An Introduction to MultiAgent Systems (em inglês). Baffins Lane: John Wiley & Sons. p. xi. 348 páginas. ISBN 0-471-49691-X

- ↑ Cheong, Fah-Chuh (1996). «11: MUD Agents and Chatterbots». Internet Agents. Spiders, Wanderers, Brokers and Bots (em inglês). Indianapolis: New Riders. p. 249-280. 413 páginas. ISBN 1-56205-463-5

Ligações externas[editar | editar código-fonte]

Organizações relacionadas a IA[editar | editar código-fonte]

- http://www.ed.conpet.gov.br/br/converse.php robo programa pelo governo para defender suas questões (site 100% em português).

- American Association for Artificial Intelligence